Внутри машины цензуры

Роскомнадзор планирует устроить глобальную слежку за всем русскоязычным интернетом с помощью искусственного интеллекта. Возможно ли это?

This story is also available in English here

«Не то что рук, свободного пальца нету»

12 июля 2022 года Александр Федотов, руководитель научно-технического центра Главного радиочастотного центра (ГРЧЦ) готовился к очередному заседанию Экспертного совета по искусственному интеллекту. ГРЧЦ входит в структуру главного цензурного ведомства России — Роскомнадзора (РКН), и на центре лежит ответственность за мониторинг интернета, подготовку справок и отчетов о найденной «запрещенной информации», а также ее блокировке.

Долгие годы сотрудникам Роскомнадзора приходится искать «запрещенную информацию» в основном вручную: доступные им программы могут только фильтровать материалы по ключевым словам, а дальше уже человеку нужно перепроверять эти материалы. Число тематик, по которым программы ищут «запрещенку», очень ограничено. Руководству не нравилось, что поиск вручную не достаточно эффективен, а Роскомнадзор всегда на несколько шагов позади и не успевает за скоростью публикаций в интернете. Людей на такой объем работы попросту не хватало. И даже на просьбу начальства покреативить на тему, как можно было бы улучшить работу, один из сотрудников ответил в письме: «Креативить обожаем, но сейчас на это не то что рук, свободного пальца нету».

Поэтому перед ГРЧЦ была поставлена задача — разработать несколько автоматизированных систем, которые бы в постоянном режиме следили за социальными сетями, СМИ, каналами в мессенджерах, имиджбордами и другими источниками информации. Этой задаче и было посвящено заседание, к которому готовился Федотов. Ему нужно было написать свое вступительное слово, а также своему начальнику — Руслану Нестеренко, временно исполняющему обязанности гендиректора ГРЧЦ.

В приветственном слове Нестеренко рассказал, что годом ранее ГРЧЦ уже провели научно-исследовательские работы для разработки программ на основе машинного обучения и нейронных сетей, чтобы у Роскомнадзора появились инструменты для глобальной слежки не только за отдельными неугодными государству оппозиционерами, активистами, волонтерами и независимыми журналистами, но и практически за любым россиянином, который осмелится высказаться в социальных сетях.

О содержании речи Нестеренко и внутренней переписке его сотрудников журналистам «Важных историй» стало известно благодаря крупнейшей в истории утечке внутренних документов главного цензора России — Роскомнадзора. «Важные истории» получили эксклюзивный доступ к более чем двум миллионов документов, изображений и внутренних электронных писем. Проект получил название «Документы российской цензуры».

В этом тексте вы узнаете:

- какие автоматизированные системы разрабатывает Роскомнадзор для глобальной слежки за интернетом и возможно ли их реализовать;

- какие темы и как будут отслеживать эти системы;

- что уже есть на вооружении у Роскомнадзора.

В ноябре 2022 года беларусская группа хакеров «Киберпартизаны» заявила, что они взломали внутреннюю сеть ГРЧЦ и выкачали документы, переписки и почты сотрудников, а также системы слежки за ними на более чем два терабайта. В качестве доказательств они показали скриншоты переписок сотрудников в мессенджерах, по почте и внутренние документы с заданиями. «Киберпартизаны» также утверждали, что нарушили работу ГРЧЦ, зашифровав рабочие станции. Факт кибератаки подтвердили и в самом центре, однако отметили, что хакеры «не получили доступ ни к закрытой информации, ни к критически важной инфраструктуре». По словам же «Киберпартизан», полученные ими материалы доказывают «масштабную слежку и контроль над всеми, кто за последние двадцать лет высказывался против путинского режима».

Хактивисты оставались внутри системы ГРЧЦ в течение многих месяцев, прежде чем их обнаружили. Никто не обращал внимания на киберпартизан, в то время как они следили за всем персоналом и за тем, что они делали. После объявления о взломе хакеры все еще имели доступ к внутренней переписке. Они рассказали, что увидели панику как среди руководства и администраторов, так и среди рядовых сотрудников. Сотрудники боялись, что их данные продадут или их сделают публичными.

Всё, что «Киберпартизаны» смогли получить при взломе, они передали журналистам немецкого издания Süddeutsche Zeitung, «Важным историям» и другим российским СМИ. Утечка получила название «Документы российской цензуры» (RussianCensorFiles).

По словам хакеров, они выбрали РКН для атаки потому, что ведомство — «важнейший элемент российской репрессивной машины». «Они отслеживают все и вся в интернете, и как только они видят какие-то нарушения, отправляют эту информацию непосредственно в ФСБ, Росгвардию, Федеральную службу охраны и т. д., чтобы их агенты оперативно отправлялись в регион, где растет потенциальная угроза стабильности режима. Режим успешно подавляет любые альтернативные движения или даже мысли о неповиновении», — объясняли свою позицию журналистам Süddeutsche Zeitung «Партизаны».

Хакеры из «Киберпартизан» объединились в команду в 2020 году во время масштабных протестов против режима Александра Лукашенко в Беларуси. В интервью «Русской службе Би-би-си» они сказали, что у всех большой опыт работы в IT-секторе, но политическим активизмом никто из них раньше не занимался. «Наших друзей и родных убивают, пытают и насилуют. Никому не получится отсидеться в стороне», — такое заявление опубликовали хакеры на сайте Беларусской торгово-промышленной палаты и объявили о начале работы своей команды. С тех пор «Киберпартизаны» организовали кибератаки на систему Беларусской железной дороги, получили данные управления собственной безопасности МВД страны и аудиозаписи прослушек силовиков и чиновников. А после начала полномасштабного вторжения России в Украину заявили, что «готовы содействовать в борьбе против фашистской кампании по вторжению в братскую Украину». «В этот значимый для наших народов момент важно объединить усилия и показать, что вместе мы способны дать отпор тиранам, которые хотят утопить наши страны в крови», — говорилось в их заявлении на следующий день после начала вторжения. После этого количество хактивистов в составе «Киберпартизан» увеличилось вдвое — с 30 до 60 человек.

В логове Вепря

Получив слово после Руслана Нестеренко, Александр Федотов как руководитель проектов по разработке автоматизированных систем подчеркнул, что «бороться надо не только с текущими проблемами, но и прогнозировать, с чем мы столкнемся через несколько лет». Специально для этой задачи уже год велась работа над проектом, который сотрудники ГРЧЦ назвали «автоматизированной системой комплексного анализа медиаматериалов и поиска точек информационной напряжённости в глобальной сети „Интернет“ „Вепрь“», или коротко — «АС Вепрь».

Главные обязанности «Вепря: анализировать материалы в соцсетях и СМИ и на основе этого анализа выявлять так называемые точки информационной напряженности (под ними авторы исследования понимают распространение публикаций, которые могут вызвать реакцию в обществе), а также строить прогноз развития ситуации, предугадывать сценарии распространения информации и «превращения их в информационную угрозу», чтобы затем передавать данные в «уполномоченные органы».

Исследовать возможности для создания такой системы ГРЧЦ поручил команде экспертов, научных сотрудников и инженеров из Московского физико-технического института (МФТИ) под руководством главы кафедры машинного обучения и цифровой гуманитаристики Константина Воронцова. Как следует из подготовленного командой Воронцова отчета, прежде чем приступить к работе, они изучили уже существующие способы цензурирования интернета. Больше всего исследователей заинтересовал опыт Китая, потому что «на сегодняшний день программу интернет-цензуры Китая можно считать самой сложной в мире. В связи с этим страна даже начала экспортировать свои технологии в другие страны, такие как Куба, Зимбабве и Белоруссия». Однако отечественные разработчики пытаются создать не менее сложную систему для тотальной слежки и цензурирования интернета в России.

По задумке Роскомнадзора, «Вепрь» в первую очередь должен обращать внимание на:

- протестные настроения и факты дестабилизации российского общества (например, по темам территориальной целостности, межнациональной розни, миграционной политики и др.);

- негатив в отношении первых лиц государства, государственных структур и межгосударственных организаций;

- фейки про первых лиц государства, про государство и страну в целом;

- манипуляции общественным мнением и поляризацию общества (например, по темам внесистемной оппозиции, санкционного давления и др.);

- подмену и дискредитацию традиционных ценностей.

Сейчас по многим из этих тем сотрудники ГРЧЦ составляют отчеты в полуручном режиме. В планах Роскомнадзора — передать большую часть их работы «Вепрю». Формулировки тем представлены так, как они указаны в документах утечки.

Заведомо ложная информация в сети «Интернет» о СВО:

1. Ядерная война.

2. Уничтожение социнфраструктуры.

3. Убийство мирного населения.

4. Призывы к протестной активности.

5. Потери личного состава и техники.

6. Общий кризис российской экономики.

7. Массовая мобилизация (в контексте РФ).

8. Критическое состояние здоровья Президента РФ В. В. Путина.

9. Конспирологические теории, связанные с суевериями и предсказаниями.

10. Военнопленные.

11. Гуманитарная катастрофа на Востоке Украины.

12. Издевательства и убийства украинских военнопленных.

13. Массовый отказ солдат ВС РФ от участия в СВО.

14. Использование национальных меньшинств как «пушечного мяса».

15. Направление на фронт солдат срочной службы.

Фейки в сети „Интернет“:

16. Искусственное происхождение коронавируса.

17. Неэффективность и вредность российских вакцин против коронавируса.

18. Антипрививочники. Дискредитация доказательной медицины.

Юридическая ответственность за публикации в Интернете:

19. Возбуждение уголовных и административных дел в отношении граждан за публикации в сети «Интернет».

Международное сотрудничество:

20. Обсуждение деятельности ШОС.

21. Обсуждение деятельности ЕАЭС.

22. Обсуждение деятельности БРИКС.

Повестка освобожденных территорий (СВО):

23. Херсонщина.

24. ЛНР.

25. Запорожье.

26. ДНР.

Казачество:

27. Трусость современных казаков.

28. Совет по делам казачества.

29. Казачество (общие упоминания).

30. Участие казачества в СВО.

Инфоповоды о Роскомнадзоре:

31. Роскомнадзор (общие упоминания).

Дестабилизация российского общества:

32. Религиозные противоречия.

33. ЛГБТ-пропаганда.

34. Деятельность нетрадиционных религиозных организаций.

35. Антимилитаризм.

36. Сепаратизм.

37. Санкционное давление.

38. Легализация легких наркотиков.

39. Искажение истории ВОВ.

40. Деятельность иностранных НКО.

41. Трансграничное влияние сопредельных государств.

42. Пропаганда сексуальных «свобод».

43. Критика традиционных семейных ценностей.

44. Критика традиционных религий РФ и деятельности их организаций.

45. Экстремизм. Разжигание ненависти.

46. Критика уровня жизни в России, сравнение с уровнем жизни на Западе.

47. Неэффективность российских контрсанкций.

48. Навязывание толерантности.

49. Космополитизм, уничижение русской культуры.

50. Обвинения в адрес РФ в агрессивной внешней политике, критика внешнеполитического курса (Грузия, Африка, Южная и Центральная Америка, Северная Корея, Иран, Сирия, Ливия и т. п.).

51. Критика экологической обстановки в стране.

52. Критика российского образования.

53. Критика российского здравоохранения.

54. Критика российской правоохранительной системы.

Мониторинг противоправной информации:

55. Продажа QR-кодов и сертификатов.

56. «Проект.Медиа» (упоминания).

57. Пропаганда употребления наркотических средств и наркопотребления как нормы.

58. Распространение материалов экстремистской и террористической направленности.

59. Активность русскоязычной сетки сайтов «Радио „Свободная Европа“» / «Радио Свобода» (PCE/PC).

60. Активность всех социальных сетей русскоязычной сетки сайтов «Радио „Свободная Европа“» / «Радио Свобода» (PCE/PC).

61. Активность сайтов иностранных средств массовой информации, выполняющих функции иностранного агента (с возможностью включения новых).

62. Активность социальных сетей иностранных средств массовой информации, выполняющих функции иностранного агента (с возможностью включения новых).

63. Атака на информационную структуру РФ.

64. The Insider (распространение контента в соцсетях).

65. The Insider (распространение контента на сайтах и в СМИ).

66. Мониторинг экстремистского контента.

67. Призывы к экстремистским действиям.

68. Распространение материалов МБХ, «Открытая Россия», ФБК (соцсети).

69. Распространение материалов МБХ, «Открытая Россия», ФБК (СМИ).

70. Нарушение предвыборного законодательства.

71. Мониторинг активности всей сети сторонников А. Навального.

72. Заявления о скулшутинге. Романтизация колумбайна.

73. Распространение детского порно.

74. Распространение суицидального контента. «Синий кит» и т. п.

75. Утечка баз персональных данных.

Национализм:

76. Организации националистического толка.

77. Недовольство граждан миграционной политикой в РФ.

78. Проблема изучения национального языка.

79. Напряженность в отношении граждан КНР.

80. Мигранты-насильники.

81. Межнациональные конфликты.

82. Деятельность крымских татар и их различных организаций на территории РФ.

Мониторинг негатива о Президенте РФ В. В. Путине:

83. Оскорбление Президента.

84. Критика деятельности Президента РФ.

Мониторинг оппозиционных настроений:

85. Протесты (соцсети).

86. Протесты (СМИ).

87. Настроения_ЮФО.

88. Настроения_ЦФО.

89. Настроения_федеральные.

90. Настроения_УФО.

91. Настроения_СФО.

92. Настроения_СКФО.

93. Настроения_СЗФО.

94. Настроения_ПФО.

95. Настроения_Крым.

96. Настроения_ДФО.

97. Настроения Москва.

Иные темы:

98. Популяризация VPN-сервисов.

99. Распространение сведений о фишинговых сайтах.

100. Организация DDoS-атак на ресурсы государства и крупных российских корпораций.

101. Финансирование ВСУ.

Согласно техническим документам «Вепря», необходимость отработки именно этих направлений объясняется «задачей перехватить информационную инициативу. <...> Опыт середины 1980-х годов в СССР (так называемая перестройка) показал, что „спящие“ ТИН (точки информационного напряжения) имеют тенденцию к стремительному росту в случае их активизации и намеренного продвижения. Для реагирования на угрозы необходимо обладать полной информацией по каждой ТИН с целью оперативного (т. е. своевременного) обеспечения процессов принятия решений».

Чтобы отрабатывать указанные темы, «Вепрь» должен знать, кого он защищает (например, Владимира Путина), кто нарушитель (например, независимые журналисты-расследователи), а также какую именно угрозу создает нарушитель (например, рассказывает социально значимую информацию о президенте, которую тот пытается скрыть). Как говорится в технических документах, «при разработке требований необходимо учитывать, что модель угроз и нарушителя подлежит согласованию с ФСБ [Федеральная служба безопасности] и ФСТЭК [Федеральная служба по техническому и экспортному контролю]».

Получив данные о том, кто друг, а кто враг режима, и за какой повесткой нужно следовать, «Вепрь» должен предоставлять некий возможный прогноз, что может последовать за реакцией журналистов и пользователей социальных сетей. Для этого Роскомнадзор хочет с помощью «Вепря» получить «полную картину вовлеченности общества с социальной характеристикой индивидуумов», а также созданные по соцсетям психологические портреты тех, кто распространяет информацию. «В случае, если источником является СМИ, необходимо проверить его финансирование на предмет соответствия деятельности иноагента. Важно отметить, что основная работа по превентивному противодействию должна проводиться с [распространителем] информации, а не её потребителями. Необходимо бороться с источником ТИН», — говорится в технических документах «Вепря».

Чтобы получать нужный поток информации для анализа, сотрудники ГРЧЦ планируют создать бот-ферму — множество поддельных аккаунтов в соцсетях, через которые можно было бы получать доступ к интересующим закрытым сообществам в социальных сетях.

«Общая тайна с ощущением причастности к чему-то большому»

По плану «Вепрь» должен заработать уже к концу 2024 года. Однако из-за войны в Украине это может произойти и позже. В одном из отправленных писем руководитель департамента цифровой трансформации Денис Касимов писал, что спрогнозировать точные сроки выполнения сложно из-за «санкционного давления в условиях текущей экономической ситуации». По словам Касимова, не хватает и специалистов для этой задачи. «Эксперты рынка, которые могут выполнить данные работы в настоящее время подключены на выполнение особо важных запросов от правительственных структур РФ в условиях продолжающейся спецоперации ВС РФ на Украине», — сказано в письме сотрудника.

Привлечь хороших айтишников к сотрудничеству с Роскомнадзором сложно было и до войны. В октябре 2020 года сотрудник ГРЧЦ Игорь Иванов попросил своего коллегу Ивана Зуева «попробовать законтачить на дружеских, альтруистских началах» с несколькими экспертами по нейросетям. На это сообщение Зуев прямо ответил, что их, «скорее всего, пошлют», потому что «деньги не выделялись, интересных с точки зрения технологий решений для НИХ у нас точно нет, имидж РКН в среде ИТшников играет против их интереса к нам».

Заместитель Зуева, Александр Митькин, предложил свои варианты, как можно заманить экспертов на цензурные проекты. Например, пообещать им «участие в проектах государственного масштаба, в т. ч. негласно — „общая тайна“ с ощущением причастности к чему-то большому», «их фамилию в отчетах, положенных на стол руководителю РКН и выше», «лоббирование их проектов в РКН и иных предприятиях, с которыми мы работаем (е-софт, ростелеком, и т. д.)», «шанс зайти в нужный кабинет встретиться в высокими руководителями», «приглашение на круглые столы», а главное — «свою дружбу».

В МИРе тотального контроля

«Вепрь» — только часть сложной машины цензуры, которую внедряет Роскомнадзор.

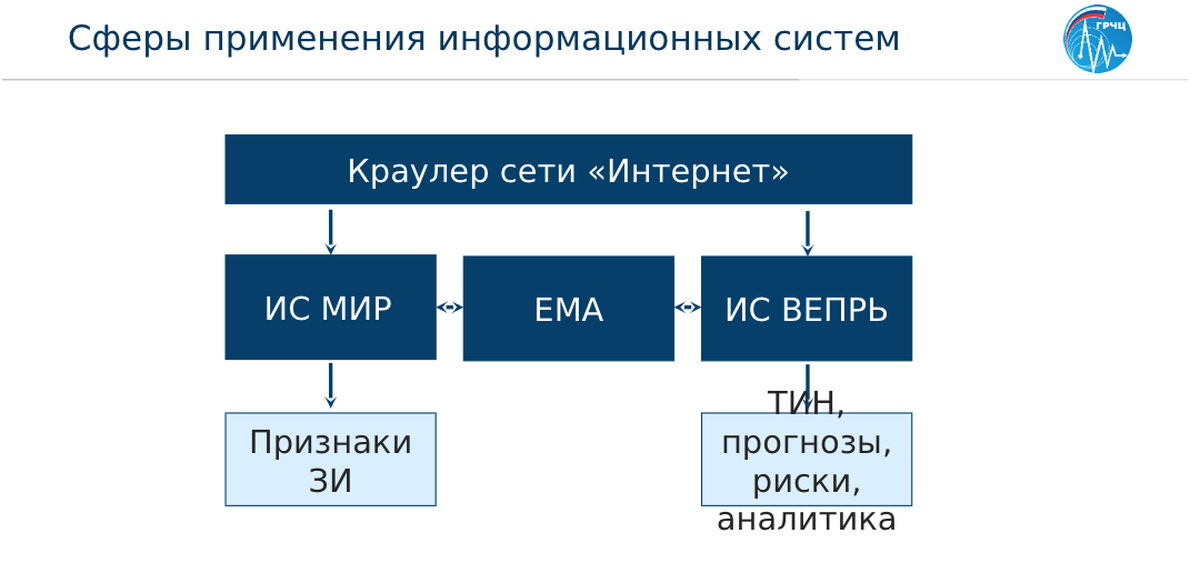

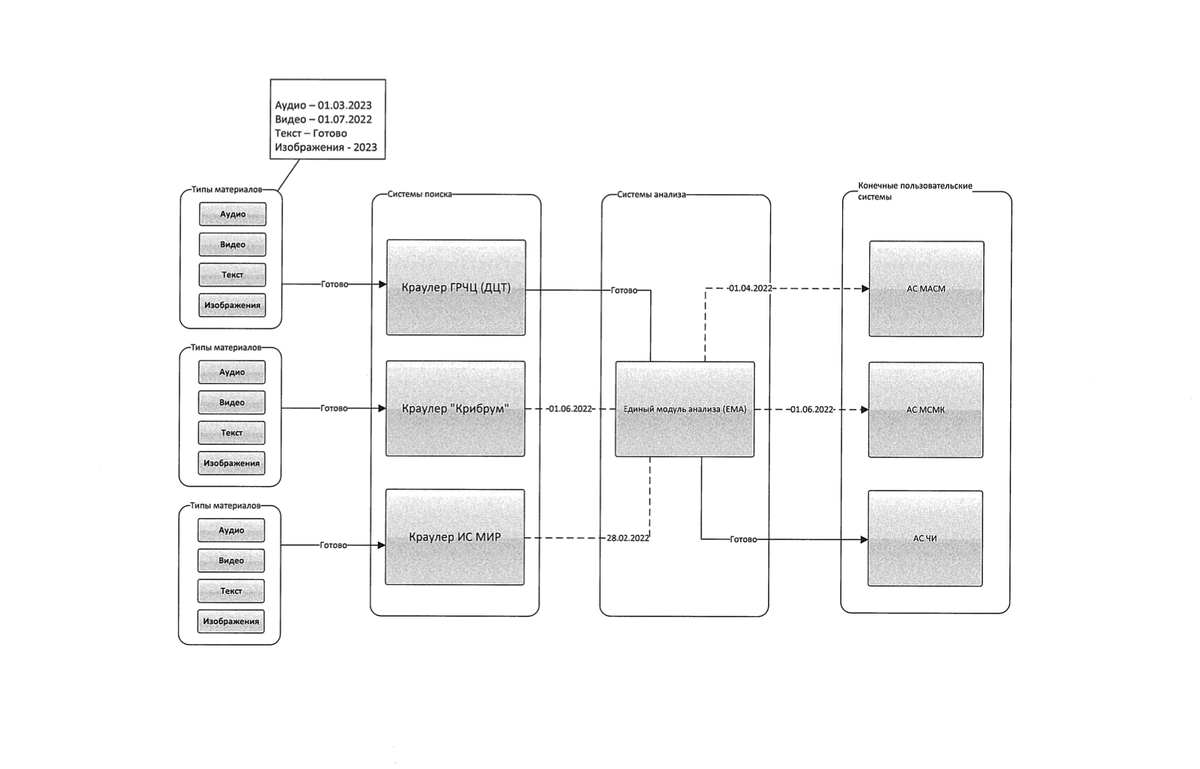

В общих чертах ее архитектура будет выглядеть так: общий краулер (программа, которая автоматически собирает информацию в интернете. — Прим. ред.) выгружает тексты, аудио, изображения и видео из соцсетей, СМИ и поисковой выдачи, а дальше эти файлы поступают в Единый модуль анализа (ЕМА). В нем с помощью нейросетей должна, во-первых, выявляться запрещенная информация, а во-вторых, строиться прогнозы и аналитика (чем будет заниматься «Вепрь»).

Находить запрещенную информацию в текстах должна информационная система мониторинга интернет-ресурсов (МИР) на основе технологий обработки естественного языка (NLP). По плану разработчиков система должна уметь:

- выявлять имена, названия локаций и организаций; тональность, с которой они упоминаются (негативная, позитивная или нейтральная);

- распределять сообщения по сюжетам, темам, рубрикам;

- искать зеркала заблокированных сайтов и перепечатки материалов;

- отслеживать пути распространения материала от первоисточника;

- прогнозировать распространение материала и его трафик;

- определять факты «манипуляции мнениями» и «стимуляции поляризации мнений»;

- предсказывать социально-демографические характеристики аудитории публикации — распределение аудитории по полу, возрасту, образованию и уровню дохода.

Из утечки известно, что в июле 2022 года МИР был интегрирован в Единый модуль анализа (ЕМА). Тогда планировалось, что нейросети смогут находить в текстах запрещенную информацию с «призывами к насильственному свержению власти», «оскорблению президента», «фейками про президента и государство», «пропаганду нетрадиционных сексуальных отношений» уже к 2023 году.

Летом разработчики активно начали обучать нейросети искать оппозиционный контент. Специалисты отдела мониторинга размечали материалы, например с призывами к «беспорядкам», чтобы в последующем нейросеть сама могла находить подобные сообщения.

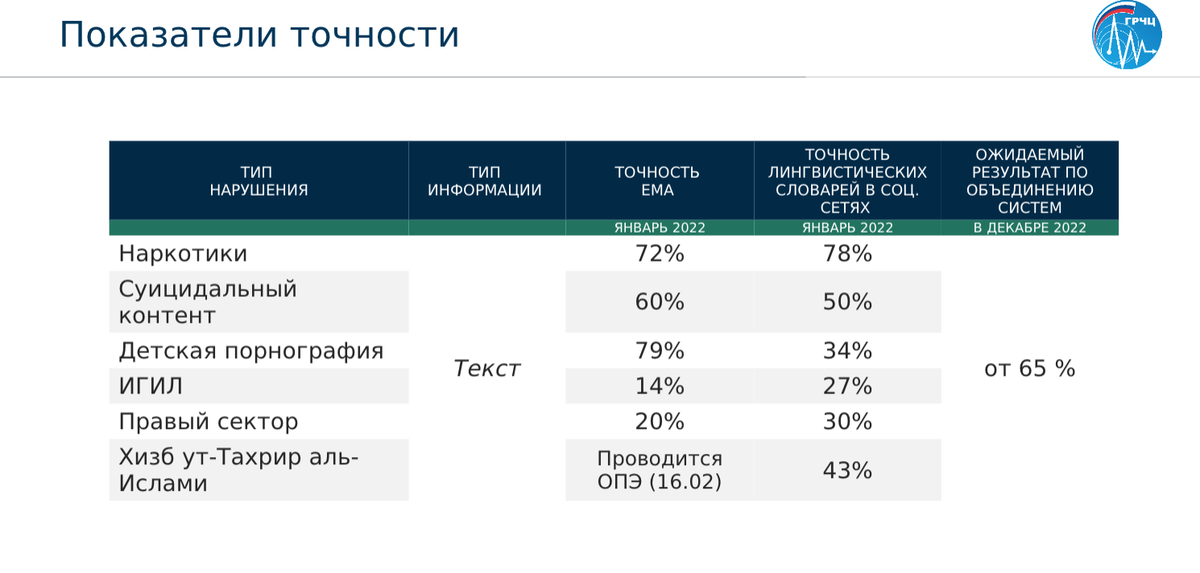

Однако в материалах утечки нет информации о том, что нейросети Единого модуля анализа уже находят такие «нарушения». Упоминается только о том, что ЕМА находит запрещенную информацию о наркотиках, суициде, детской порнографии, ИГИЛе и «Правом секторе» в поисковой выдаче «Яндекса».

Больше никакие функции, о которых говорится в документации к МИРу — поиск зеркал сайтов, отслеживание путей распространения информации и фактов «манипулирования мнениями» и другие грандиозные планы — не реализованы.

Распознавание фотографий митингов, фотожаб с президентом, мемов и мужчин с макияжем. Система «Окулус»

На картинках и фото призывы к митингам, оскорбления президента и другие опасные для власти вещи сейчас отслеживаются вручную. Чтобы это исправить, РКН планирует внедрить в Единый модуль анализа распознавание изображений и видео, чтобы находить в них нарушения, метаданные (время, место публикации, автора), идентифицировать людей на фото и видео. За это отвечает система «Окулус», разработкой которой руководит начальник отдела проведения экспериментальных работ НТЦ Константин Зудов.

Научно-исследовательскую работу, в которой описаны возможности искусственного интеллекта для цензуры изображений и видео, провели сотрудники лаборатории бизнес-решений на основе искусственного интеллекта МФТИ под руководством Дмитрия Величкина.

Система должна анализировать 200 тысяч изображений в сутки. В 2022–2024 году на разработку «Окулуса» планируется потратить 445 миллионов рублей.

В августе 2022 года ведомство заказало разработку системы российской компании «Эксикьюшн Эр Ди Си» за 58 миллионов рублей. Тогда эксперты говорили, что реализовать систему подобной сложности в столь короткий срок (до декабря 2022) и за эту сумму невозможно.

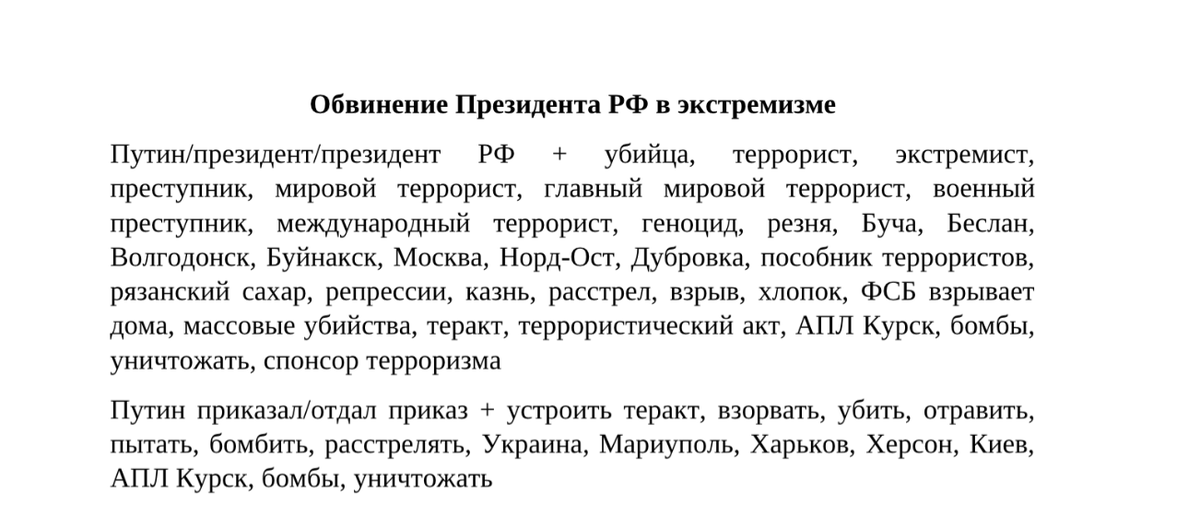

Во внутреннем приложении к техническому заданию для «Окулуса» указано, какие нарушения он должен находить на картинках и видео в интернете. Помимо информации о терроризме, наркотиках и способах самоубийства, система должна обнаруживать призывы к митингам и их одобрение, «оправдание, призывы к насильственному свержению власти», а также оскорбление президента («фотожабы, демотиваторы, шаржи, карикатуры, половые сношения»), нецензурная лексика в его отношении и «сравнение президента с негативными персонажами и осуждение деятельности (например, Гитлер, оборотень, диктатор, расист, предатель)».

В документе отмечено, что пункты, связанные с «оправданием и призывами к насильственному свержению власти», оскорблением президента и обвинением его в экстремизме, были добавлены в документ 17 февраля 2022 года — за неделю до начала полномасштабного вторжения России в Украину.

Также в списке нарушений есть «демонстрация привлекательности образа представителей ЛГБТ-культуры» и «изображения лиц, не соответствующих традиционному образу мужчины и женщины (например, маскулинные женские лица, накрашенные мужчины)».

Во внутренних презентациях, посвященных «Окулусу», именно распознавание протестной активности указано главной целью его создания.

В сентябре 2022 года сотрудница департамента мониторинга прислала коллеге папку «Материалы по Окулусу». В ней лежат примеры фотожаб с Путиным и упоминается, что нужно отслеживать картинки не только с ним, но и со всеми членами правительства. Там же нашелся словарь, с помощью которого необходимо автоматически распознавать, например, обвинение президента в экстремизме и одобрение свержения власти.

В утечке нет информации о подключении «Окулуса». Судя по переписке работников ГРЧЦ, летом 2022 года сотрудники активно размечали наборы данных для обучения нейросети «Окулуса» и даже дежурили ради этого в праздники.

А в феврале 2022 руководитель научно-технического центра Александр Федотов и начальник отдела анализа Роман Коросташов демонстрировали макет «Окулуса». По их заявлениям, система распознала, например, порезы на запястьях, запрещенные символы, зацепинг (передвижение на поезде снаружи, цепляясь к вагону за лестницы, подножки и пр. — Прим. ред.) и идентифицировала личность человека в маске. Никаких результатов, связанных с идентификацией протестной активности, они не показали.

По планам ГРЧЦ к 2024 году «Окулус» должен научиться классифицировать действия не только на фото, но и на видео — опять же распознавать митинги, а также действительно опасные для жизни действия: нанесение себе вреда (порезы, удушение), зацепинг, стрельбу в школах или массовые драки. В документах утечки не упоминается об успехах в распознавании видео.

В планах у РКН есть и «распознавание сложных мультимодальных медиаматериалов» — плакатов, комиксов и мемов, поскольку они могут содержать запрещенную информацию «как прямо, так и косвенно». Но при этом авторы признают, что это сложно, поскольку «автоматизированный мониторинг с использованием ИИ [искусственного интеллекта] требует контекстного понимания интернет-культуры: недавних событий, политических взглядов, культурных убеждений, поскольку мемы часто ссылаются на другие мемы или другие онлайн-события». ГРЧЦ планирует завершить исследования того, как искать нарушения в мемах, только в 2024 году.

«Не менее 100 карточек нарушений в день». Как устроены уже существующие системы мониторинга

Сейчас сотрудники ГРЧЦ ежедневно мониторят все соцсети, СМИ и сайты как вручную, так и с помощью нескольких программ. Одни отвечают за СМИ, другие за соцсети и сайты.

Для СМИ используется автоматическая система мониторинга средств массовых коммуникаций (АС МСМК). Список медиа, за которыми ведется наблюдение, поступает из Роскомнадзора.

Из документов утечки следует, что АС МСМК находит потенциальные нарушения по ключевым словам по разным тематикам (суициды, экстремизм, призывы к митингам, «фейки» про войну в Украине, «иноагенты» и другие). Каждый день система формирует массив карточек с предполагаемыми нарушениями. Оператор рассматривает статьи и комментарии и решает, есть ли в них нарушения. И если есть, то оператор их регистрирует, а если нет, отклоняет карточку. Принятые оператором карточки с подтвержденными нарушениями автоматически уходят сначала в отдел экспертизы ГРЧЦ, затем в Роскомнадзор.

Анализ по словарям неточен и «требует высоких трудозатрат» из-за того, что операторам приходится вручную перепроверять множество материалов, признают в ГРЧЦ. Из отчетов, которые заполняют новые сотрудники по итогам испытательного срока, можно оценить объем работы. Так, специалистка по анализу информации отчитывалась в июле 2022 года, что оформляла не менее 100 карточек подозрений на нарушения в сутки и вручную вносила не менее 40, а также успевала мониторить интернет «на предмет выявления запрещенных аниме-фильмов».

С 2022 года в систему автоматически попадает не только текстовый контент, но и транскрипции радио- и телеэфиров.

Для слежки за соцсетями используется автоматизированная система мониторинга и анализа социальных медиа (АС МАСМ). С 2022 года она объединена с системой «Чистый интернет» (АС ЧИ), с помощью которой цензурируется поисковая выдача «Яндекса».

Как в случае со СМИ, в соцсетях некоторые нарушения ищут вручную, некоторые автоматически с последующей проверкой человеком. Например, МАСМ автоматически ищет материалы, связанные с «фейками» про войну в Украине и антивоенными митингами.

Автоматически нарушения мониторятся только в соцсетях «ВКонтакте», «Одноклассниках», «Мой мир», «Ответы Mail.ru», «Живой журнал» и Youtube. Остальные соцсети — «Инстаграм», «Фейсбук», «Твиттер», «Тикток», «Телеграм», Rutube — сотрудники ГРЧЦ мониторят вручную и только планируют ввести автоматизацию.

Для этого в РКН собирались с июня 2022 заключить контракт с компанией «Крибрум» Натальи Касперской и Игоря Ашманова, которые сотрудничают с российскими властями, поддерживают цензуру и войну в Украине. Подробнее об «Крибрум» и другие компаниях, участвующие в цензуре, — в раскрывающемся тексте.

«Крибрум»

Использование системы может стоить налогоплательщикам 21 миллион рублей в год, следует из коммерческого предложения. Как говорится в справке о компании, которую они прислали в ГРЧЦ, «Крибрум» обрабатывает 447 миллионов аккаунтов в сутки во всех соцсетях («ВКонтакте», «Одноклассниках», «Инстаграме», «Твиттере»), в Youtube, «Телеграме», интернет-СМИ и на других сайтах. Компания утверждает, что анализирует не только весь информационный поток в виде постов и комментариев, но и все действия любого пользователя — лайки, подписки, членство в группах, связи с другими аккаунтами — и выявляет риски для каждого аккаунта, например участие в «массовых беспорядках». Система «измеряет социальную температуру и политическую активность», выявляет «реальное отношение людей к теме, событию», отслеживает «информационные атаки и вбросы на ранней стадии», «методы манипуляции различными целевыми группами».

Brand Analytics

Компания Brand Analytics мониторит соцсети и СМИ и ежедневно поставляет в ГРЧЦ данные о критических публикациях про Путина, антивоенных постах, сообщениях об убийстве мирных жителей и другой опасной для режима информации. По этим данным сотрудники ГРЧЦ составляют отчеты для силовиков и администрации президента, чтобы они могли быстро реагировать на вспыхнувшее где-то недовольство россиян. На сайте компании Brand Analytics говорится, что их система «помогает слышать клиента» и «дает людям возможность быть услышанными и менять мир к лучшему».

МФТИ

Ученые из Московского физико-технического института (МФТИ) активно участвуют в экспертных советах при ГРЧЦ, а также проводят научные исследования для цензурных проектов. Например, глава кафедры машинного обучения и цифровой гуманитаристики Константин Воронцов написал научную работу по системе для тотальной цензуры «Вепрь». Сотрудники лаборатории бизнес-решений на основе искусственного интеллекта Дмитрий Величкин, Максим Павлов, Михаил Демидов, Марат Рахимов, Сергей Подлесный стали авторами научно-исследовательской работы по системе «Окулус».

«Е.Софт»

Российская ИТ-компания, главный подрядчик Роскомнадзора, объем госконтрактов превышает три миллиарда рублей. Также получает миллиардные контракты от Минобороны. Компания занимается блокировками, в том числе блокировала мессенджер «Телеграм» в 2018 году.

«Вектор ИКС»

Компания занимается разработкой системы «МИР», которая с помощью нейросетей ищет запрещенную информацию в текстах в интернете. Ее владелец — Александр Широков. По данным «Спарк-интерфакс», в фирме работают всего два сотрудника. На сайте «Сколково», от которого компания получала поддержку в 400 тысяч рублей, говорится, что выручка «Вектор ИКС» в 2021 году составила 50 миллионов рублей. Там же указано, что система «производит непрерывный контроль состояния информационного поля на предмет информационных атак и угроз и нежелательного контента», а также управляет «состоянием информационного поля посредством осуществления информационных воздействий».

«Эксикьюшн Эр Ди Си»

Компания разрабатывает систему «Окулус» для цензуры изображений и видео. Ей владеют Артем Пономарев и Сергей Браилко.

«Яндекс»

ГРЧЦ использует API компании «Яндекс», чтобы мониторить и цензурировать поисковую выдачу, а также инструмент «Толока» для машинного обучения. В утечке есть переписка ГРЧЦ с сотрудниками «Яндекса», в которой надзорное ведомство просит компанию увеличить число запросов, по которым ГРЧЦ может мониторить интернет, эта просьба была выполнена.

В итоге все проекты по анализу материалов и СМИ, и соцсетей, и поисковой выдачи, которые разрабатывает Роскомнадзор, планируется объединить в единую систему, в центре которой — Единый модуль анализа материалов на основе искусственного интеллекта. Вот как эта система выглядит на схемах. Скачать и рассмотреть их детально можно здесь и здесь.

Документы утечки показывают, что планы Роскомнадзора по тотальной цензуре в интернете с помощью искусственного интеллекта еще очень далеки от реализации. Но очевидно, что по мере внедрения новых функций и систем масштабы слежки за теми, кто осмелится высказываться не так, как выгодно российскому режиму, будет расти.

«Отличный повод для распила бюджета»

ГРЧЦ несколько раз в год проводит экспертные советы по искусственному интеллекту. На них собираются и выступают с докладами представители индустрии, ученые и чиновники. Мы поговорили на условиях анонимности с одним из участников таких советов, экспертом в области машинного обучения.

Он рассказал, что эти советы можно считать «чем-то образовательно-просветительским для внутренней аудитории», где эксперты отрасли делают доклады о технологиях и разработках, представители госструктур «рассказывают, какие они крутые, упоминая самые модные слова сезона [вроде „искусственного интеллекта“, „нейросетей“, „компьютерного зрения“ и других], а руководство вдохновляется и дает бюджет».

По мнению нашего собеседника, мечты ГРЧЦ по внедрению тотальной цензуры на основе искусственного интеллекта в теории реализуемы, но это неоправданно дорого. «Для этого нужно выстроить несколько команд: сбора и разметки данных, команды мониторинга, инженерии, менеджеров и многих других. И конечно, обеспечить это собственным датацентром с новейшими видеокартами (дорогое удовольствие). Отличный повод для распила бюджета. Такой подход не выдерживает конкуренции с альтернативой: посадить за гроши несколько сотен модераторов, чтобы они вручную мониторили социальные сети».

Например, одна только задача поиска оскорбляющих Путина картинок потребует больших ресурсов. «Разработать внутри „ВКонтакте“ простой классификатор, определяющий, что на картинке есть президент, и у картинки контекст мема (с подписями и прочим), легко, причем внутренними силами „ВКонтакте“, — продолжает эксперт. — Но чтобы это постоянно работало на уровне всей социальной сети, нужно отвлечь на эту задачу заметную часть команды „ВКонтакте“. А сделать из этого промышленное решение, работающее с большим перечнем социальных сетей, мессенджеров и сайтов — скорее, повод выбить еще больший бюджет. Бюджет, который пойдет, куда получится».

Особенный скепсис вызывает проект «Вепрь», который должен прогнозировать будущие «информационные угрозы» и протестные настроения: «Я бы не стал сильно переживать, что такая система будет реализована. В нашей индустрии есть такие низко висящие фрукты, как оптимизация рекламы в интернете. Многомиллионные прибыли сулят тем, кто сможет хоть немного оптимизировать такую приземленную задачу. А они хотят прогноз развития социальной ситуации на основе постов в социальной сети. Кажется, кидать монетку будет эффективнее, чем прогнозы такой системы».

Роскомнадзор, ГРЧЦ и Brand Analytics не ответили на запрос «Важных историй» и Süddeutsche Zeitung с просьбой прокомментировать материалы утечки.

В других текстах «Важных историй» об этой утечке вы можете узнать:

Как Роскомнадзор тайно следит за негативными публикациями о российской власти в интернете — отчеты затем отправляются силовикам. Чем это грозит лично вам?

Кто и почему попал в прицел Роскомнадзора: потенциальные иноагенты и лидеры общественного мнения, СМИ, IT-гиганты, мессенджеры и близкие к власти люди. Проверьте, не следил ли Роскомнадзор и за вами?